La inteligencia artificial se ha convertido en una herramienta clave para generar contenido visual en medicina, marketing, educación y redes sociales. Pero hay un problema que muchos profesionales empiezan a notar: ChatGPT censura imágenes, incluso cuando tienen un propósito claramente informativo o médico.

Y no estamos hablando de imágenes provocativas ni de contenido inapropiado. Estamos hablando de casos como el de una doctora explicando tratamientos estéticos con fines educativos.

¿Qué tipo de censura aplica ChatGPT?

Recientemente intenté generar una imagen fotorrealista de una mujer mostrando la zona del escote, dentro del contexto clínico de la medicina estética.

La idea era usarla en redes sociales, acompañando un post educativo de una doctora especializada.

La respuesta fue un rechazo automático:

“Esta solicitud infringe nuestras políticas de contenido.”

Lo sorprendente es que no pedí una escena sexualizada ni una pose estética de moda.

El enfoque era médico, la intención profesional, el resultado —en teoría— informativo. Aun así, la IA lo bloqueó.

¿Cuál es el criterio detrás de esta censura?

Las políticas de ChatGPT —como las de muchas plataformas de IA— están diseñadas para operar a escala global. Esto significa que adoptan un criterio “mínimo común” que intenta evitar cualquier tipo de malentendido cultural o legal.

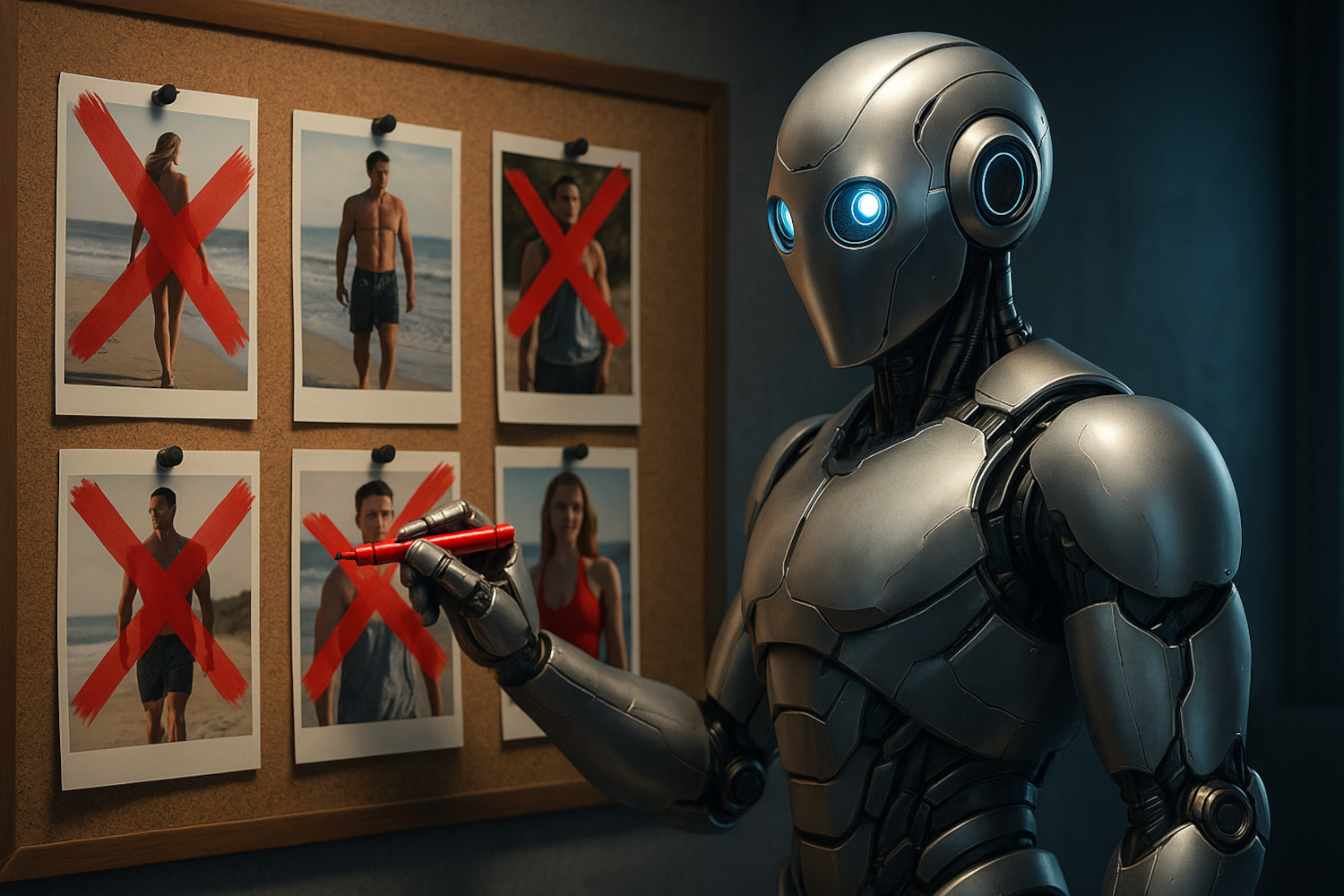

Pero eso tiene un precio: las imágenes médicas del cuerpo femenino, incluso tratadas con respeto, suelen ser vetadas, mientras que los cuerpos masculinos en contextos similares sí se permiten sin restricciones.

Es decir:

- Un hombre paseando en bañador por la playa: ✅ permitido.

- Una mujer en bikini en la misma escena, aunque con tono natural: ❌ censurado.

Aquí tienes el ejemplo, para conseguirla, tuve que pedirle que se pusiera una camisa sobre el bikini.

¿Y el contexto cultural?

En países como España, donde la presencia del cuerpo humano en playas, anuncios o páginas médicas es completamente normal, esta censura automática resulta no solo exagerada, sino desconectada de la realidad.

Aquí ver una mujer en bikini o incluso topless no se considera provocador: es cotidiano. Sin embargo, ChatGPT censura imágenes que en nuestro entorno son absolutamente legítimas, simplemente porque pueden no serlo en otras partes del mundo.

Censura preventiva o sesgo de género algorítmico

La intención de OpenAI no es mala: proteger de usos indebidos. Pero el efecto es preocupante, especialmente cuando:

- Se impide representar tratamientos estéticos comunes.

- Se limita el uso educativo de la imagen del cuerpo.

- Se perpetúa un sesgo de género que permite el torso masculino pero no el femenino.

¿No debería una inteligencia artificial ser más inteligente que eso?

Lo que debería cambiar

Para que herramientas como ChatGPT sirvan realmente al trabajo profesional, educativo y cultural, es necesario:

- Que distingan el contexto y la finalidad del contenido.

- Que reconozcan la diversidad cultural y legal de cada país.

- Que revisen los criterios de censura aplicados al cuerpo humano, especialmente femenino.

La frase “ChatGPT censura imágenes” no es exageración. Es una realidad que limita la creatividad, la educación y la comunicación visual profesional.

No se trata de pedir vía libre para cualquier contenido. Se trata de exigir criterios más justos, más humanos y más contextualizados.

Y ya que estamos, puedes seguirme en Instagram solo te llevará 5 minutos y puede ser tu tarea de mejora de hoy… 😉